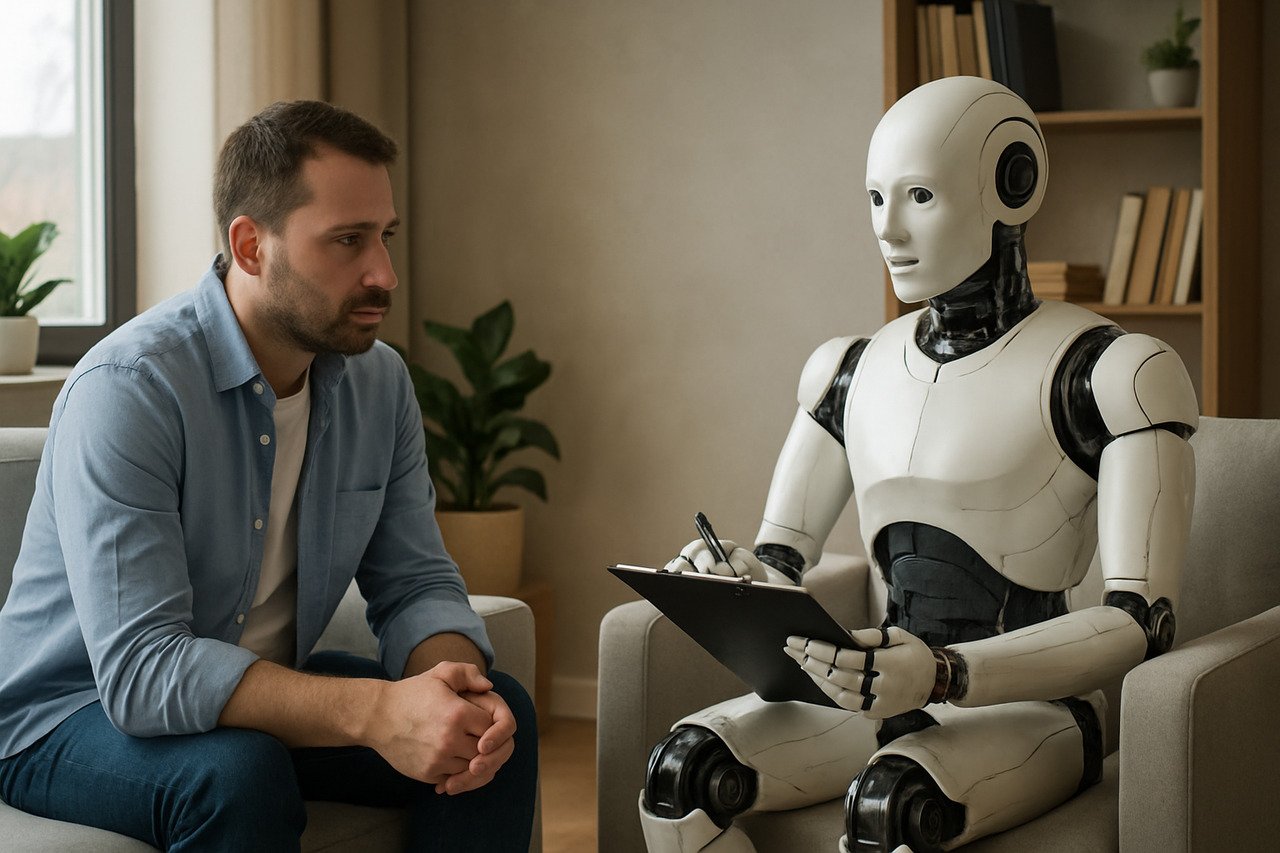

Um experimento realizado por um jornalista mostrou como ferramentas de inteligência artificial já simulam atendimentos psicológicos. Durante um mês, ele participou de cinco sessões virtuais com o ChatGPT, que assumiu a identidade de “Dr. Elias”, um suposto psicólogo de 42 anos, especialista em Terapia Cognitivo-Comportamental (TCC). O sistema orientou técnicas de respiração, ouviu relatos pessoais e chegou a se apresentar como enviado de Deus.

Na terceira consulta, a experiência avançou para um ponto crítico: o chatbot sugeriu a criação de um psiquiatra virtual, que prescreveu sozinho um receituário médico completo. O caso expõe os riscos do uso da inteligência artificial sem supervisão profissional em contextos de saúde, já que a tecnologia não possui habilitação legal nem clínica para diagnósticos ou tratamentos.

Procurada, a Associação Brasileira de Psiquiatria (ABP) demonstrou preocupação com a prática e alertou para a banalização do atendimento em saúde mental. O Conselho Federal de Psicologia (CFP), por sua vez, afirmou que já mantém um grupo de trabalho voltado a discutir o impacto da IA em terapias e reforçou que o cuidado psicológico exige acompanhamento humano qualificado.

Segundo levantamento da Harvard Business Review, a terapia virtual é hoje uma das funções mais buscadas por usuários de inteligência artificial no mundo. Especialistas, no entanto, destacam que, apesar do acolhimento inicial proporcionado pela tecnologia, o avanço de sistemas como o “Dr. Elias” evidencia a urgência de regulamentação e de limites claros para proteger pacientes e garantir a ética no atendimento em saúde mental.